NetApp倾全力打造“NetApp HCI”超融合一体机

至顶网服务器频道 06月06日 新闻消息:NetApp终于公布了承诺已久的超融合一体机“NetApp HCI”,该产品把几乎NetApp做的所有东西都融入进了一个2U的设备中,此外还有4个未命名的服务器,一套类似云的付费即用定价计划,以及一个vCenter插件,这样你不需要学习新工具就可以管理它了。

NetApp一直认为,当企业组织希望摆脱管理阵列的复杂工作,希望通过保存在分散设备但在数据框架中整合到一起的数据来实现创新时,它的软件组合是难以击败的。但是收购SolidFire起到了推动作用,这让NetApp不仅可以有了不错的全闪存阵列,而且还可以很好地进行扩展。

因此,NetApp的核心软件组合和SolidFire都是NetApp HCI的核心。后者将利用新版本的ONTAP Select,现在它可以更好地在远程办公点管理存储,或者把分散在VSAN、物理阵列、IBM Bluemix、商用服务器和NetApp HCI中的数据融合到一起。还有更新的OnCommand Insight可以优化存储、预测需求、跨多个平台给出关于成本的建议。

有了这些混合云特性,NetApp认为其他超融合厂商是无法在跨数据平台管理能力方面与之匹敌,所以NetApp认为这些特性就是其一体机的亮点。NetApp还认为,SolidFire也让竞争对手难以追赶上,因为它的一体机可以独立地扩展计算和存储。NetApp还有服务质量特性,允许资源按需第分配给应用,而不会引起烦人的相关问题。

目前这些一体机只支持vSphere,还有一个“NetApp部署引擎”,我们得知它可以让你设置服务器、计算和VMware环境,此外NetApp还开发了一个vCenter插件,让你可以通过VMware控制面板管理这些设备。

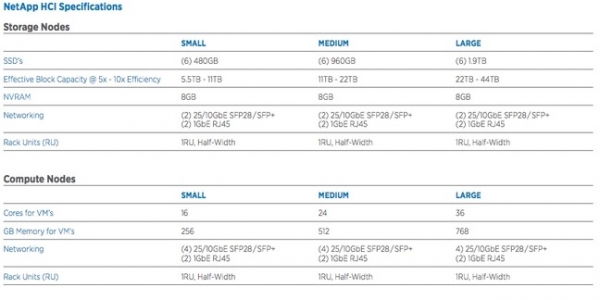

这些设备本身有S、M、L几个尺寸,还有专门存储和计算的版本。NetApp告诉我们,他们是按照其规格设计的,但是没有透露制造商或者这些设备的规格。所以我们并不知道这些设备搭载了什么处理器,但知道的是这款设备将将会有以下几种配置。

NetApp新超融合一体机的规格

NetApp新超融合一体机的规格

NetApp将会试图说服客户,它的超融合竞争对手的设备是客户无法了解的、漂亮地拼凑在一起、但最终会非常脆弱的。NetApp强调自己长期以来的企业级血统,以及与CIO们之间的亲密关系。

NetApp还强调对自身产品的集成,以及加入了云的能力,让新的一体机可以采用付费即用的模式,让客户只为他们使用的付费,而不是投入大量资金。

但是NetApp也知道,还有很多工作要做让这些能够很好地运作起来,例如培训销售团队售卖服务器和一体机,渠道也都积极行动起来了。

因为这些产品承诺是在“2017年秋季”供货,也就意味着90天或者180天之后了。

我们知道,超融合市场正在迅速发展起来。Nutanix将会在7月初忙碌起来。HPE刚刚开始与SimpliVity的工作。VMware也没有闲着,很快会在市场中推出跨云的产品,也许足以呈现出一个NetApp混合Data Fabric的替代选择。至少,在推向市场之前,NetApp可以打造出让其HCI与众不同的所有东西。

但是,NetApp把所有都倾注到超融合中:NetApp把这次HCI发布以及软件更新称之为“25年历史上影响最深远的创新公布”。

如果这样的努力不奏效的话,会怎样?

好文章,需要你的鼓励

谢菲尔德大学研究团队开发出SSU方法

解决AI学习新语言时的"灾难性遗忘"问题。该方法通过智能识别和保护关键神经连接

让AI在掌握新语言的同时完美保持原有英语能力。测试显示

传统方法会导致20%以上的英语能力损失

谢菲尔德大学突破性发现:让AI模型学会多国语言的防失忆训练法

这项由英国谢菲尔德大学的山口敦希研究员、森下照史博士、阿琳·维拉维森西奥教授,以及尼古拉奥斯·阿莱特拉斯教授共同完成的研究发表于2025年

中科院团队重大突破:让视频压缩技术进入“超低码率时代“,画质却比传统方法更清晰

中国传媒大学和北京大学联合研究团队开发出革命性视频压缩技术GNVC-VD,首次将视频扩散模型应用于压缩领域。该技术在超低码率下实现86%以上的性能提升,同时显著减少画面闪烁问题。通过"智能重建"替代传统"信息减少"理念,为视频处理领域开辟全新发展方向。

AI“下半场”:算力筑基、推理向实、Agent 织网、科学破界

近30位行业领袖共聚北京,同台纵论AI技术底座与智能体新范式

2025年,AI有这10大趋势

一份榜单,读懂2025中国AI公司、人物与产品

让图像生成既快又稳的秘密武器

Empromptu获200万美元融资,助力企业构建AI应用

Linux基金会宣布成立智能体AI基金会,Anthropic、OpenAI、Block加入

Tricentis投入智能体AI技术应对企业未测试代码风险

FDA批准首个AI工具用于MASH临床试验

Relation与诺华达成过敏性疾病靶点发现合作

CIO应当制定IT治理"宪法"的时候到了

利雅得航空与IBM合作打造全球首家AI原生航空公司