DRAM,速度很快:SK海力士迈向HBM3E领域

在美光第二代HBM3芯片亮相一个月后, SK海力士正在对一款HBM3E芯片进行采样。

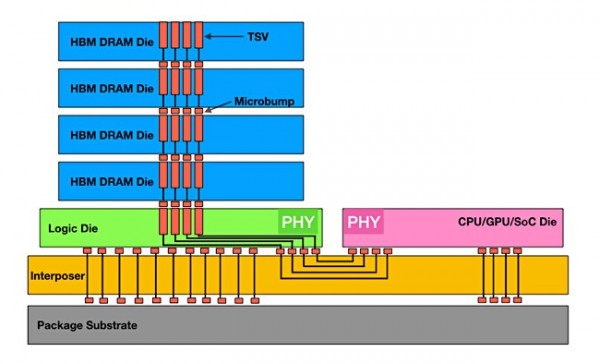

HBM3E是第3代高带宽存储器扩展版,遵循2022年1月推出的HBM3标准。这种存储器是由放置在逻辑模具上方的DIMM芯片堆集构建的,并通过中介器连接到GPU或CPU上。或者,存储芯片可以直接堆叠在GPU上。无论哪种方式,DRAM到GPU/CPU的带宽都高于通过插槽连接到处理器的DRAM的传统X86架构。行业机构JEDEC规定了HBM标准,其HBM3标准于1月发布。现在,在人工智能和机器学习热潮的推动下,供应商们正急于让它过时。

过去一段时间存储市场需求低迷,存储器和NAND供应过剩,如今存储器市场开始出现一些复苏迹象。SK海力士DRAM产品规划主管Sungsoo Ryu表示:“通过增加高价值HBM产品的供应份额,SK海力士也将寻求快速的业务转型。”

HBM世代表。

该公司自称是世界上唯一的HBM3产品“大规模生产商”之一,并计划从明年上半年开始批量生产HBM3E。SK海力士谈到了其为人工智能市场生产的内存,目前由于对ChatGPT型大型语言模型(LLM)的需求而大幅扩大。SK认为LLM处理是内存有限的,并旨在纠正这一点。

SK海力士产品的细节很少,该公司只表示每秒可处理高达1.15 TB的数据,相当于每秒处理230多部5GB大小的全高清电影。美光上个月宣布了一款超过1.2TBps的HBM3第二代产品,这表明SK海力士还有工作要做。

美光的HBM3第2代产品采用8层堆叠,容量为24GB,即将推出36GB容量的12层堆叠版本。SK海力士于4月宣布推出12层堆栈HBM3产品,容量为24GB。

我们怀疑SK海力士的HBM3E产品可能是基于这款容量为24GB的12层堆叠产品开发的,并且可能实现36GB的容量。

SK海力士表示,HMB3E产品与HBM3向下兼容;只要把它放在现有的设计中,系统即可更快运行。

好文章,需要你的鼓励

AI智能体漏洞挖掘成本骤降,Anthropic呼吁AI防御

Anthropic发布SCONE-bench智能合约漏洞利用基准测试,评估AI代理发现和利用区块链智能合约缺陷的能力。研究显示Claude Opus 4.5等模型可从漏洞中获得460万美元收益。测试2849个合约仅需3476美元成本,发现两个零日漏洞并创造3694美元利润。研究表明AI代理利用安全漏洞的能力快速提升,每1.3个月翻倍增长,强调需要主动采用AI防御技术应对AI攻击威胁。

NVIDIA联手多所高校推出SpaceTools:AI机器人有了“火眼金睛“和“妙手回春“

NVIDIA联合多所高校开发的SpaceTools系统通过双重交互强化学习方法,让AI学会协调使用多种视觉工具进行复杂空间推理。该系统在空间理解基准测试中达到最先进性能,并在真实机器人操作中实现86%成功率,代表了AI从单一功能向工具协调专家的重要转变,为未来更智能实用的AI助手奠定基础。

Spotify年度盘点2025首次推出多人互动功能“盘点派对“

Spotify年度总结功能回归,在去年AI播客功能遭遇批评后,今年重新专注于用户数据深度分析。新版本引入近十项新功能,包括首个实时多人互动体验"Wrapped Party",最多可邀请9位好友比较听歌数据。此外还新增热门歌曲播放次数显示、互动歌曲测验、听歌年龄分析和听歌俱乐部等功能,让年度总结更具互动性和个性化体验。

机器人学会“三思而后行“:中科院团队让AI机器人告别行动失误

这项研究解决了现代智能机器人面临的"行动不稳定"问题,开发出名为TACO的决策优化系统。该系统让机器人在执行任务前生成多个候选方案,然后通过伪计数估计器选择最可靠的行动,就像为机器人配备智能顾问。实验显示,真实环境中机器人成功率平均提升16%,且系统可即插即用无需重新训练,为机器人智能化发展提供了新思路。

AI测试成数智化合规必选项,驱动企业高质量发展

AI智能体漏洞挖掘成本骤降,Anthropic呼吁AI防御

Spotify年度盘点2025首次推出多人互动功能"盘点派对"

英国SAP用户因商业套件重启授权迷局感到困惑

AWS发布Graviton5定制CPU,为云工作负载带来强劲性能

美光放弃Crucial品牌:告别消费级存储市场

手机里的NPU越来越强,为什么AI体验还在原地踏步?

如何使用现有基础设施让数据做好AI准备

IT领导者快问快答:思科光网络公司首席数字信息官Craig Williams分享AI转型经验

Anthropic CEO警告AI行业泡沫化,批评"YOLO"式投资

雅虎利用AI实时总结橄榄球比赛精彩内容

押注AI智能体,奇奇科技跨越十年的“换挡”与远航