企业数据一机整备 群晖Active Backup for Business让备份告别繁琐

L先生最近很头疼,作为一家刚起步信息公司的CIO,老板给了他一个重要任务:备份。备份对于企业数据来说的确是一件极为重要的事情,但是一家公司的数据不仅包括服务器、 虚拟机,还包括员工电脑和公有云的数据,要在短时间内一一搞定这些数据的备份,特别是不同平台、不同软件环境下的备份,实属一桩头疼事。而且还要考虑到如果由于各种内外因导致设备中断服务,如何在短时间内还原备份数据,这也是需要在布建IT架构时提前考虑的。

本着初创公司“开源节流”的精神,最终L先生选用了群晖Active Backup for Business备份方案,实现了一站式备份并获得了老板的认可。让我们看看其中的奥秘究竟在哪里?

服务器、虚拟机、个人电脑一站式备份方案 不需要再买买买

在过去,企业数据备份往往需要根据不同情况,在服务器端安装昂贵的备份软件,再进行复杂的硬件设置才能完成备份设定,X86服务器和Linux服务器的备份又要使用到不同的软件和方案,不仅部署过程耗费大量精力,而且对于拥有多台不同操作系统的服务器备份,其成本也将耗费企业更多的财力。再加上公司众多的PC,可能一份文件会重复存储在多台PC中,去重也成为释放存储空间容量的重要功能。

群晖Active Backup for Business不仅支持Windows/Linux文件服务器的备份,同时也支持VMware虚拟机备份,并且无需在源服务器上安装昂贵的软件,也不会影响服务器端的稳定性和性能,只需在公司部署一台群晖 NAS,进入套件中心下载Active Backup for Business 套件并完成设置,即可做到一机搞定所有备份,甚至连公司内的PC也都可以整机备份。

备份也要讲究方法 贴心功能让你事半功倍

如果好不容易搞定传统备份解决方案,刚想松口气的L先生又将面临一系列的问题:如何适应不同的备份软件不同的界面?备份数据如何集中存储?面对越来越多的备份数据又如何管理?所有的一切在群晖Active Backup for Business上都不再是问题,除了拥有一站式备份功能,在备份数据管理、虚拟机备份验证、集中管理界面上也同样是拿手好戏。

群晖Active Backup for Business内建全局重复数据删除技术来大幅降低存储空间使用量,并且还具备区块级增量备份技术,来优化备份空间使用同时也提升备份效率。并且还可以自定义增量备份的保留规则,以更大化的使用存储空间容量。

除此以外,Active Backup for Business还整合了Windows Shadow Copy,因此可以确保服务器的备份版本保持高度一致。

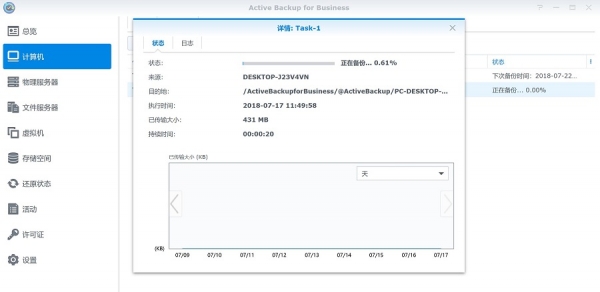

完成备份后,Active Backup for Business在总览界面可以管理来自不同类型的服务器备份,直观的UI让L先生无需在多个远程桌面上对各个服务器的备份进行查看,从时间和任务角度监控备份流量,不仅工作效率提升了,而且也节省了宝贵的服务器存储空间。

多重还原方式 确保公司持续运行

对L先生这样的企业来说,备份犹如银行存款,不仅越多越好,而且在必要时能及时“取款”才能救急,如果万一遇到需要数据恢复的场景,若无法及时、快速、准确恢复数据,那么轻则造成业务中断,重则造成经济损失。

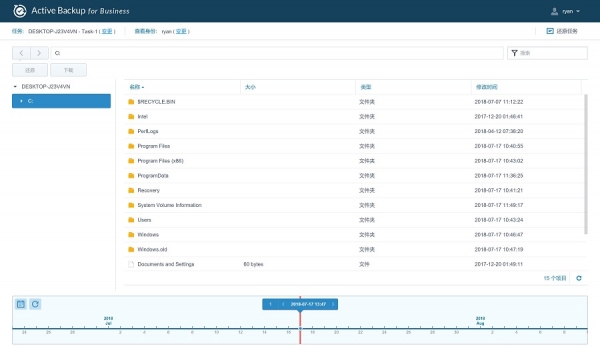

群晖Active Backup for Business以一目了然的时间轴方式显示所有备份,若公司数据受损,哪怕是普通员工也可也以很直观的快速选择时间轴上的点来还原个人工作文档,除了操作更简便,也减少IT人员的处理时间。另外,Active Backup for Business还整合了Synology Virtual Machine Manager(VMM),即使备份的虚拟机无法正常运行也可以通过VMM还原,保了公司系统服务的连续运行。

总结:对于像很多类似于L先生的公司来说,丢数据=丢钱,而对于L先生这样的CIO,丢数据=丢饭碗,要想数据不丢,还得靠谱的备份才能解决根本问题。群晖Active Backup for Business备份系统不仅省钱而且实用,也解决了服务器、虚拟机、员工电脑的数据备份问题,从而降低数据丢失的风险。

好文章,需要你的鼓励

埃森哲投资Profitmind,押注AI智能体变革零售业

埃森哲投资AI零售平台Profitmind,该平台通过智能代理自动化定价决策、库存管理和规划。研究显示AI驱动了2025年假日购物季20%的消费,约2620亿美元。部署AI代理的企业假日销售同比增长6.2%,而未部署的仅增长3.9%。Profitmind实时监控竞争对手价格和营销策略,并可创建生成式引擎优化产品文案。

上海AI实验室让机器人“睁眼看世界“:用视觉身份提示技术让机械臂学会多角度观察

上海AI实验室联合团队开发RoboVIP系统,通过视觉身份提示技术解决机器人训练数据稀缺问题。该系统能生成多视角、时间连贯的机器人操作视频,利用夹爪状态信号精确识别交互物体,构建百万级视觉身份数据库。实验显示,RoboVIP显著提升机器人在复杂环境中的操作成功率,为机器人智能化发展提供重要技术突破。

CES 2026:日立与英伟达、谷歌云、Nozomi Networks达成合作协议

日立公司在CES 2026技术展上宣布了重新定义人工智能未来的"里程碑式"战略,将AI直接应用于关键物理基础设施。该公司与英伟达、谷歌云建立重要合作伙伴关系,并扩展其数字资产管理平台HMAX,旨在将AI引入社会基础设施,变革能源、交通和工业基础设施领域。日立强调其独特地位,能够将AI集成到直接影响社会的系统中,解决可持续发展、安全和效率方面的紧迫挑战。

英伟达团队突破AI训练瓶颈:让机器人同时学会多种技能不再“顾此失彼“

英伟达研究团队提出GDPO方法,解决AI多目标训练中的"奖励信号坍缩"问题。该方法通过分别评估各技能再综合考量,避免了传统GRPO方法简单相加导致的信息丢失。在工具调用、数学推理、代码编程三大场景测试中,GDPO均显著优于传统方法,准确率提升最高达6.3%,且训练过程更稳定。该技术已开源并支持主流AI框架。