神秘FabricXpress为X-IO边缘计算能力添砖加瓦

50微秒存储访问延迟与1200万IOPS让X-IO公司的Axellio服务器成为边缘高性能方案中的佼佼者。

时至今日,服务器创新工作已经开始在除商用CPU及内存之外的各个层面作出探索,这也使得非服务器供应商有机会对主流厂商发起冲击--而X-IO作为一家存储企业也就此推出了自己的Axellio产品。

其采用直接访问NVMe存储技术,旨在对服务器产品发起一轮彻底变革,从而确保其能够以微秒级延迟访问数TB级别闪存数据,同时以实时方式并行提取并处理大量数据。

X-IO公司此前可谓麻烦缠身,但其如今已经重新回归并完成债务清算与业务重组,EBITDA(即未计利息、税项、折旧及摊销前的利润)亦再度恢复健康。其ISE产品线的销售与收入支持并推动了Axellio的开发,而如今这款产品终于做好与广大用户见面的准备。

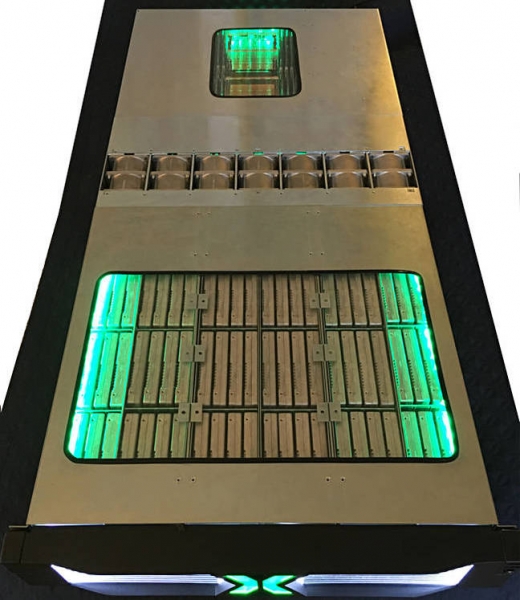

Axellio设备原型设计

这是一台融合型服务器与存储系统,能够向外扩展至多套大规模集群当中。根据X-IO公司的测试,其可线性扩展至256节点,而节点容纳上限甚至将超过1000个。

X-IO公司希望能够将此类服务器用于物联网边缘计算,即接收由大量传感器通过网络链接所生成的大量导出数据,并以实时方式对其进行同步提取与分析处理。如此一来,客户将不再需要把数据迁移至其它服务器系统即可完成处理分析。而为了实现这种现场处理效果,此类服务器必须具备强大的CPU资源与快速访问存储机制。

大家可以将Axellio视为一台不存在高成本检查机制与对接外部块存储阵列专有网络的DSSD。

因此,在硬件方面,我们可以看到一台2U机架式机柜中包含:

• 2 x 2块至强服务器主板

• 4插槽至强E5-26xx v3与v4 CPU

• 16到88个计算核心(当前水平)

• 24到176个线程(当前水平)

• 可升级至新型英特尔CPU

• 32 DIMM, 16 GB到2 TB

• 可选2 x NVDIMM以作为存储缓存

• 在12 x 6驱动器FlashPacks中容纳12到72 x 2.5英寸双端口NVMe SSD(当前为8 TB)

• 今年晚些时候将推出高达1 PB NVMe访问闪存存储容量配合16 TB NVMe SSD

• 4K数据块条件下提供1200万IOPS

• 数据采集速度大于200 Gbps(即大于30 GBps)

• 延迟低至35微秒,持续传输速率达60 GBps

Axellio机箱后视图

X-IO公司宣称,其可在低于50微秒的平均访问延迟条件下实现480 Gbps(即60 GBps)的存储数据采集与随机访问速率。一台机架内可容纳20台此类系统,从而构建起一整套高密度计算与存储环境。

该公司同时指出,这套运行有Linux的系统可接入Optane存储器,同时可使用分流处理模块:

• 2 x英特尔Phi以实现并行计算

• 2 x英伟达K2 GOU以进行视频处理

• 2 x英伟达K80 Tesla以处理科学计算及机器学习负载

• Solarflare Precision Timing Protocol(即Solarflare精确定时协议,简称PTP)数据包捕捉(简称PCAP)分流

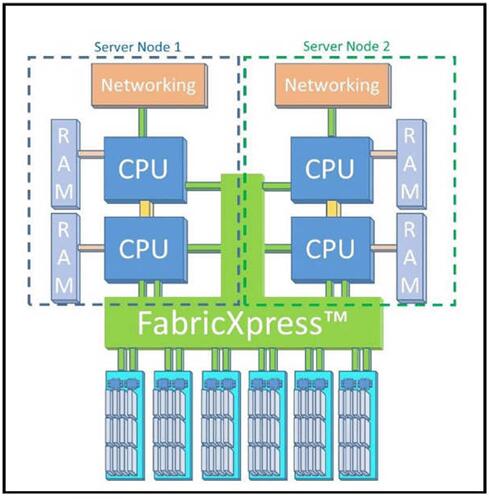

当然还远不止如此。这台双插槽服务器主板与NVMe SSD组通过一套专利FabricXpess内部通信系统实现对接。这一非透明桥接机制得以为其ODM硬件提供更为出色的边缘存储访问速度。

FabricXpress原理示意图

X-IO公司希望通过合作伙伴将该产品引入市场,并将Axellio应用于国防与情报、高复杂度数据分析、金融市场数据分析、网络安全以及通用型物联网等需要使用边缘处理设备的领域。

目前X-IO方面已经公布了Ascolta作为其合作伙伴,这家公司专门为国防及情报市场提供数据包捕捉、数据融合与分析服务。另一家合作伙伴则为ISSAC,主要负责提供端到端自动化分析能力。另外,X-IO亦与其它多家来自时间序列数据库以及网络环境监管与安全分析相关之厂商建立起合作关系。预计未来还将有更多合作协议陆续公布。

这套Axellio系统以服务器加存储引擎组件的形式向解决方案经销商合作伙伴出售。尽管如此,但在我们看来其在本质上仍然属于一台服务器,而且在销售方式上不会与思科、戴尔、HPE以及联想等竞争对手发生直接冲突。

根据我们掌握的情况,X-IO的ISE软件也将在未来被移植至Axellio系统当中。

围绕至强加DRAM这一核心进行的服务器创新活动正在快速升温,似乎每家服务器厂商都跃跃欲试。毫无疑问,X-IO也正是其中之一--Aparna Systems则是另外一家。相信未来,我们还将迎来更多新型解决方案。

来源:至顶网存储频道

好文章,需要你的鼓励

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

很多人担心被AI取代,陷入无意义感。按照杨元庆的思路,其实无论是模型的打造者,还是模型的使用者,都不该把AI放在人的对立面。

MIT递归语言模型:突破AI上下文限制的新方法

MIT研究团队提出递归语言模型(RLM),通过将长文本存储在外部编程环境中,让AI能够编写代码来探索和分解文本,并递归调用自身处理子任务。该方法成功处理了比传统模型大两个数量级的文本长度,在多项长文本任务上显著优于现有方法,同时保持了相当的成本效率,为AI处理超长文本提供了全新解决方案。

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

谷歌宣布对Gmail进行重大升级,全面集成Gemini AI功能,将其转变为"个人主动式收件箱助手"。新功能包括AI收件箱视图,可按优先级自动分组邮件;"帮我快速了解"功能提供邮件活动摘要;扩展"帮我写邮件"工具至所有用户;支持复杂问题查询如"我的航班何时降落"。部分功能免费提供,高级功能需付费订阅。谷歌强调用户数据安全,邮件内容不会用于训练公共AI模型。

华为研究团队突破代码修复瓶颈,8B模型击败32B巨型对手!

华为研究团队推出SWE-Lego框架,通过混合数据集、改进监督学习和测试时扩展三大创新,让8B参数AI模型在代码自动修复任务上击败32B对手。该系统在SWE-bench Verified测试中达到42.2%成功率,加上扩展技术后提升至49.6%,证明了精巧方法设计胜过简单规模扩展的技术理念。

联想集团混合式AI实践获权威肯定,CES期间获评“全球科技引领企业”

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

CES 2026 | 重大更新:NVIDIA DGX Spark开启“云边端”模式

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

研究发现商业AI模型可完整还原《哈利·波特》原著内容

Razer在2026年CES展会推出全息AI伴侣项目

CES 2026:英伟达新架构亮相,AMD发布新芯片,Razer推出AI奇异产品

通过舞蹈认识LimX Dynamics的人形机器人Oli

谷歌为Gmail搜索引入AI概览功能并推出实验性AI智能收件箱

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

OpenAI推出ChatGPT Health医疗问答功能

Anthropic寻求3500亿美元估值融资100亿美元