2024火山引擎AI创新巡展:五城联动,解锁AI落地新密码

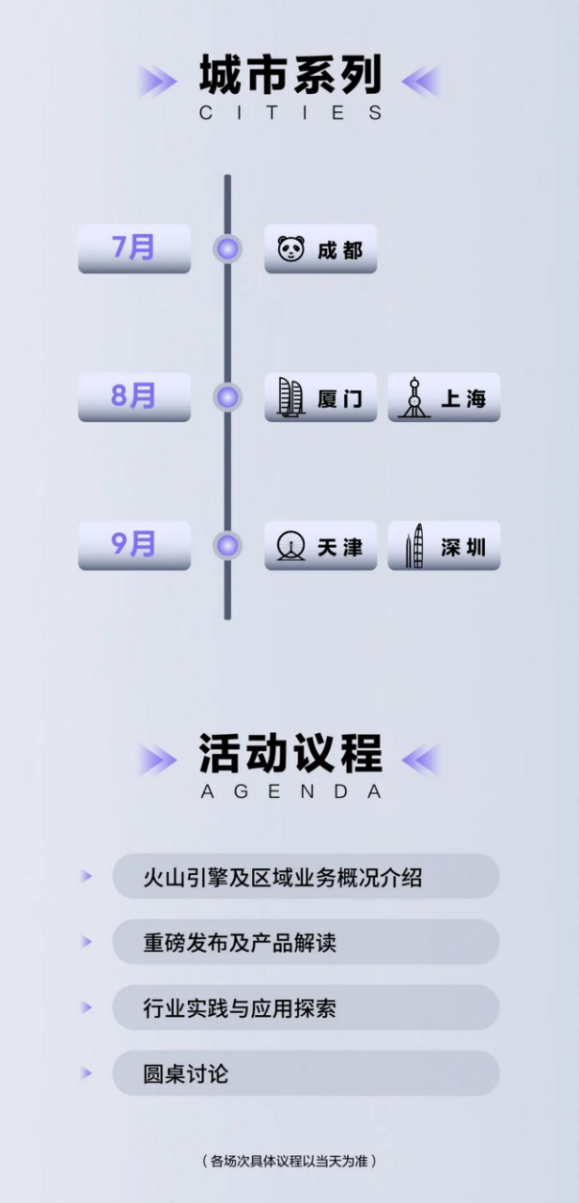

大模型技术发展与落地应用已迈入新阶段。7月25日起,“2024火山引擎 AI 创新巡展”将在成都、厦门、上海、天津、深圳五大城市精彩开启。此次巡展聚焦以大模型为代表的前沿热点产品技术,结合区域市场需求,携手企业探索 AI 时代转型机遇。

今年5月,火山引擎发布字节跳动自研豆包大模型,以大使用量打磨出更强模型,以技术驱动实现更低价格,让大模型人人用得起,通过火山引擎全栈模型服务提供的全链工具、丰富插件、安全保障和算法服务,让大模型更易落地。

此次巡展期间,火山引擎将带来豆包大模型最新家族成员,展示模型全新升级能力,更有火山方舟、扣子专业版、HiAgent 平台等多款产品和云基础设施的最新进展。来自各区域市场、不同行业的客户企业,也将基于自身场景化应用与实战经验,与现场来宾深入探讨如何解决企业在应用大模型过程中遇到的实际问题,分享成功案例和可行方案。

从技术创新走向商业落地,大模型技术为企业的 AI 转型提供了有力支持。火山引擎全栈 AI 服务将持续助力企业 AI 转型,激发业务增长潜能。诚挚邀请您参与“AI 创新巡展”,与我们共同解锁 AI“模”力,探索转型机遇!

来源:业界供稿

好文章,需要你的鼓励

大众汽车推进平价电动车战略,两款新车率先下线

大众汽车旗下ID. Polo与Cupra Raval已在西班牙马托雷尔工厂正式下线投产。两款车型起售价分别为24,995欧元和26,000欧元,均基于MEB+平台打造,搭载37kWh或52kWh电池组,续航里程最高可达454公里。这是大众"电动城市车家族"系列的首批产品,预计今年夏末秋初开始交付。大众集团通过跨品牌资源整合,实现约6亿欧元的成本节约,后续还将推出ID. Cross等新成员。

当AI机器人“自信地“撞向墙壁:STATE16研究院揭示物理AI系统中那些无声无息的致命错误

STATE16研究院这篇综述发现,物理AI系统存在"静默失效"风险——AI以高度自信执行基于错误世界信息的动作,却不触发任何报警,并提出在AI输出与物理执行之间建立独立授权层的框架。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

三星宣布将于6月8日起为Samsung Health应用推出重磅功能更新,赶在Galaxy Watch 9传闻发布之前落地。新版本将引入多项AI驱动的生物特征分析功能,包括:综合心率、血氧、皮肤温度等数据的每日活力评分(Vitals)、结合体成分数据评估长期心脏健康的心脏健康评分、优化训练强度的每日有氧负荷追踪,以及横向对比用户群体的健身指数。此外,应用界面将重新划分为睡眠、营养、活动、正念和体征五大板块,并新增抗氧化指数、年龄指数和听力保护等个性化功能。

当AI学会“边干边学“:UIUC与微软联合打造的网页智能体训练新范式

UIUC与微软联合研发的OpenWebRL框架让4B小模型仅凭400条初始数据,通过在真实网站上边做边学的强化学习方式,在网页智能体基准上超越了用27万条数据训练的竞争对手。

三星Health应用迎来AI升级,Galaxy Watch 9发布前夕更新提前揭晓

Meta智能眼镜被曝含"人脸识别"追踪代码,隐私风险引发警示

Gemini企业智能体平台的智能体RAG如何实现可靠响应

麻省理工学院AI与计算研讨会:技术进步中不可或缺的人文因素

亚马逊全新数据中心路由架构降低AWS网络能耗40%

iOS 27即将发布,多款iPhone应用将迎来全新设计升级

连接性已成为与计算和存储同等重要的AI基础设施核心要素

开发者仍在等待Meta最新AI模型的API访问权限

迈向Token经济时代,F5以“AI赋能交付”筑基智能新生态

米拉·穆拉提重返公众视野,谨慎发声

特斯拉疑似删除FSD证据,卡特彼勒加速电动化布局,高压系统技术培训刻不容缓

智能体网络流量首超真人访问,"死亡互联网"理论引发新争议

英特尔至强6加持下的火山引擎,要降低大模型的应用门槛

字节全新发布豆包AI视频模型 - 再见了Sora,你的时代过去了。

齐聚厦门,共探AI“模”力 2024火山引擎AI创新巡展8月15日见

广汽集团与火山引擎签署战略合作协议

火山引擎联合RollingAI、InfoQ共同发布《生成式 AI 商业落地白皮书》

豆包大模型日均tokens使用量超5,000亿,火山引擎全栈AI服务升级助企业加速AI转型

2024火山引擎AI创新巡展:五城联动,解锁AI落地新密码

携手火山引擎,三星Galaxy Z系列手机为用户带来AI新体验

借助大模型能力,晓多科技智能客服的效率与服务双提升

火山引擎多重优势,助力企业出海抓住 AI 新机遇