韩国公司Panmnesia推出比RDAM快三倍的CXL内存池

韩国科技公司Panmnesia在2023年的Flash Memory Summit上展示了其集中式CXL内存系统。在一次现场演示中,该系统在运行Meta推荐应用程序时展示了比基于RDMA的系统快三倍以上的性能指标。

这项CXL技术是与位于大田的韩国科学技术研究院(KAIST)合作开发的。Panmnesia已经打造了一个包括CXL CPU、交换机和内存扩展器模块的全面CXL框架。该框架拥有基于DIMM的6TB容量的CXL内存。该公司的策略是将其CXL硬件和软件知识产权产品推向CXL系统开发商和制造商。

Panmnesia的首席执行官Myoungsoo Jung博士表示:“我们很高兴能在今年的Flash Memory Summit上介绍我们创新的多TB全系统CXL框架。通过我们的CXL IP,我们致力于开拓尖端解决方案,相信这将显著提升数据中心的内存和存储能力。”

这个演示系统的容量比同样在FMS 2023展示的基于2TB三星/MemVerge的池式内存系统大三倍。

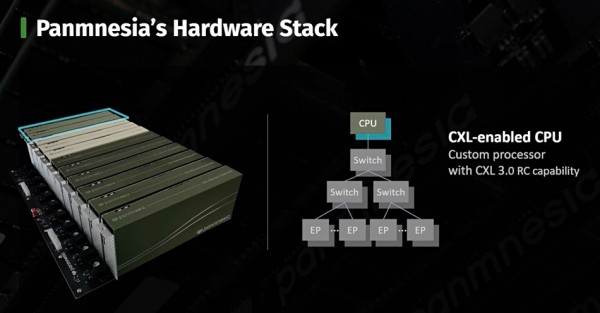

Panmnesia硬件

Panmnesia框架系统机箱有两个CXL CPU模块(如上图所示)、三个颜色较浅的CXL交换机模块和六个1TB内存模块或CXL端点控制器,形成一个统一的DIMM池。

在软件方面,该系统运行在Linux上,由CXL硬件设备驱动程序、虚拟机子系统和CXL优化的用户应用程序组成。有趣的是,虚拟机软件组件在内存空间中创建了一个无CPU的NUMA节点。

Panmnesia软件

一个视频幻灯片展示了这个CXL框架系统在类似Meta推荐应用程序的电影推荐应用中的性能。 这再次与没有添加外部内存的服务器和基于RDMA的替代方案进行了比较。

Panmnesia 与RDMA的比较

视频从加载用户和项目数据(在张量初始化期间)开始,随后使用机器学习模型进行电影推荐。Panmnesia系统完成任务的速度 是RDMA系统的3.32倍。

Panmnesia系统的另一个好处是它的模块化;内存模块中的DIMM可以被替换,可以使用更大容量的DIMM来扩展内存容量,而不需要增加额外的内存模块。

好文章,需要你的鼓励

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

很多人担心被AI取代,陷入无意义感。按照杨元庆的思路,其实无论是模型的打造者,还是模型的使用者,都不该把AI放在人的对立面。

MIT递归语言模型:突破AI上下文限制的新方法

MIT研究团队提出递归语言模型(RLM),通过将长文本存储在外部编程环境中,让AI能够编写代码来探索和分解文本,并递归调用自身处理子任务。该方法成功处理了比传统模型大两个数量级的文本长度,在多项长文本任务上显著优于现有方法,同时保持了相当的成本效率,为AI处理超长文本提供了全新解决方案。

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

谷歌宣布对Gmail进行重大升级,全面集成Gemini AI功能,将其转变为"个人主动式收件箱助手"。新功能包括AI收件箱视图,可按优先级自动分组邮件;"帮我快速了解"功能提供邮件活动摘要;扩展"帮我写邮件"工具至所有用户;支持复杂问题查询如"我的航班何时降落"。部分功能免费提供,高级功能需付费订阅。谷歌强调用户数据安全,邮件内容不会用于训练公共AI模型。

华为研究团队突破代码修复瓶颈,8B模型击败32B巨型对手!

华为研究团队推出SWE-Lego框架,通过混合数据集、改进监督学习和测试时扩展三大创新,让8B参数AI模型在代码自动修复任务上击败32B对手。该系统在SWE-bench Verified测试中达到42.2%成功率,加上扩展技术后提升至49.6%,证明了精巧方法设计胜过简单规模扩展的技术理念。

联想集团混合式AI实践获权威肯定,CES期间获评“全球科技引领企业”

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

CES 2026 | 重大更新:NVIDIA DGX Spark开启“云边端”模式

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

研究发现商业AI模型可完整还原《哈利·波特》原著内容

Razer在2026年CES展会推出全息AI伴侣项目

CES 2026:英伟达新架构亮相,AMD发布新芯片,Razer推出AI奇异产品

通过舞蹈认识LimX Dynamics的人形机器人Oli

谷歌为Gmail搜索引入AI概览功能并推出实验性AI智能收件箱

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

OpenAI推出ChatGPT Health医疗问答功能

Anthropic寻求3500亿美元估值融资100亿美元

AMD Versal家族再添新成员 ——打破AI内存桎梏 支持CXL 3.1

AI网络背景下RDMA的Why,What & How

国际高性能计算和人工智能咨询委员会第11届亚太区RDMA编程竞赛结果揭晓

韩国公司Panmnesia推出比RDAM快三倍的CXL内存池

国际高性能计算和人工智能咨询委员会举办的第十届亚太区RDMA编程赛结果出炉

英特尔退出傲腾存储业务,传统金字塔架构不灵了?

搭载第四代自研神龙架构 阿里云发布RDMA增强型实例等多款新品

国际高性能计算与人工智能咨询委员会第9届亚太区RDMA编程竞赛圆满落幕

国际高性能计算与人工智能咨询委员会宣布举办第九届亚太区高级RDMA编程研讨会和竞赛

HPC-AI咨询委员会宣布启动第七届亚太区大学生RDMA编程挑战赛招募