共建产业根基 共筑数智生态

[中国,深圳,2022年11月9日] 华为全联接大会2022在深圳线下和线上同步举办。华为与伙伴共建产业根基,助力数智生态快速发展。鲲鹏从“可用”到“好用”,全面服务国计民生行业核心场景。昇腾AI基础软硬件平台全面升级,助力科学计算进入科学智能新阶段。华为倡议成立科学智能创新联合体,携手产业界,构筑科学智能领先格局。

华为副总裁、计算产品线总裁邓泰华发表“共建产业根基,共筑数智生态”主题演讲,表示以鲲鹏构筑数字根基,以昇腾构筑智能根基,凝聚每一份数智力量,共建数智根基,共筑产业生态,开创数智时代。

鲲鹏和昇腾,与鸿蒙、HMS、华为云、面向智能驾驶的MDC一同,赋能合作伙伴,数智生态得到快速发展:搭载HarmonyOS的华为终端设备超过3.2亿;HMS海外Top 3000应用集成度达80%;华为云开发者总数突破350万;鲲鹏和昇腾伙伴数量超过5000家、解决方案数量达13000个、开发者总数超过260万。

数字根基,鲲鹏突破行业纵深

鲲鹏产业生态稳步发展,硬件伙伴出货占比已达95%以上。欧拉实现从企业主导到产业共建,快速跨越生态拐点,当前累计装机量达245万套,预计今年底在中国服务器操作系统领域新增市场份额将达25%,有望成为中国新增市场份额第一。鲲鹏开发套件DevKit和应用使能套件BoostKit持续优化,提升原生开发能力,助力开发者极简开发,今年底在国计民生行业的生态满足度将超过70%,当前已发展4200多家伙伴,已发布12000多个鲲鹏认证解决方案,在政府、金融、交通、电力等行业规模应用。

智能根基,昇腾突破产业发展

华为聚焦智能根基创新,围绕“极致性能、极简易用”持续夯实昇腾AI基础软硬件平台。CANN 6.0开放底层开发体系,算子自定义开发效率倍级提升。在大模型能力持续增强的基础上,昇思MindSpore 2.0升级为AI融合框架,原生支持科学智能。

基于昇腾AI基础软硬件平台,昇腾训练、推理解决方案全新升级,训练、推理场景中的易用性和性能全面提升。训练场景中典型模型开发周期小于0.5人周、性能领先业界20%,推理方案支持一站式全流程工具化,开发效率翻倍,模型部署后可自动增量训练,持续迭代,业务不中断,精度不断提升。

昇腾AI能力全面提升,助力人工智能计算中心建设。目前已有20多个算力节点接入中国算力网,包括人工智能计算中心、超算中心等,总算力超过3000P,算力已向社会开放,可实现一点接入,算力、数据、生态全网共享。

以大算力为基础,人工智能大模型全流程使能体系从规划、开发、产业化支持大模型创新。在开发阶段,基于昇腾的大模型开发使能平台,让大模型更易开发、适配和部署;在产业化阶段,通过遥感、多模态、流体力学大模型产业联合体将解决大模型行业应用落地及产业孵化,最终服务于千行百业。

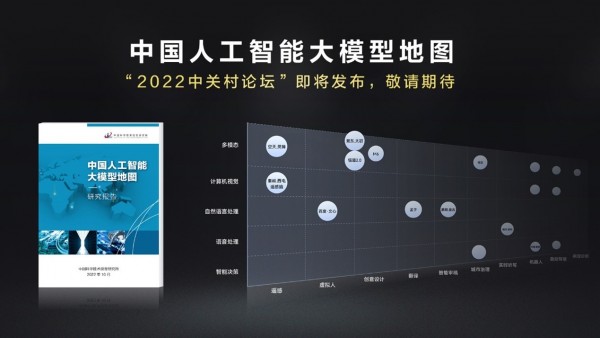

中国人工智能大模型地图预发布

当前人工智能技术趋势正朝着通用大模型方向发展,大模型具备更强泛化能力,可覆盖多业务场景,发展大模型也成为产学研各界共识。华为推出的人工智能大模型全流程使能体系从规划、开发、产业化支持大模型创新。在科技部指导下,中国科学技术信息研究所协同产业界共同规划大模型地图,并即将发布《中国人工智能大模型地图研究报告》,统筹中国大模型有序发展,结合产业联合体等形式探索大模型落地的新方法、新模式,联合打造标杆项目,加快推动大模型切实落地赋能产业发展。

引入AI,科学计算进入科学智能新阶段

科学智能涉及HPC与AI两大计算领域,覆盖AI赋能机理计算、数据驱动AI计算、机理计算与AI计算相融合三大计算场景。过去单一、烟囱状的软硬件平台已无法满足科学智能需求。华为基于鲲鹏和昇腾AI,通过创新的融合计算架构,打造原生科学智能基础软硬件平台,加速应用创新。目前已在新材料研发、大飞机设计、蛋白质结构预测等领域中应用。

为更好地聚焦产业价值场景,打通科研创新、应用示范到产业推广的通道,华为倡议成立科学智能创新联合体,携手产学研用,突破科学前沿,加速科研创新到产业落地进程,加强交叉学科建设和人才培养,共建科学智能新生态。

从2020年“智能基座“产教融合协同育人基地启动以来,华为联合教育部和72所高校,已累计培养了5000多名先锋教师,开设了1500多门课程,累计50万名学生参与了学习和实践。

面向未来,华为将持续提供课程资源、师资培训、技术专家支持,开发更多根技术教材、培养更多先锋教师、扩展更多教学手段,从鲲鹏、昇腾、华为云,扩展到5G、光、数通、存储等整个ICT领域,为数智生态发展培养源源不断的创新人才。

来源:至顶网存储频道

好文章,需要你的鼓励

奥运级别的努力:首席信息官为2026年AI颠覆做准备

AI颠覆预计将在2026年持续,推动企业适应不断演进的技术并扩大规模。国际奥委会、Moderna和Sportradar的领导者在纽约路透社峰会上分享了他们的AI策略。讨论焦点包括自建AI与购买第三方资源的选择,AI在内部流程优化和外部产品开发中的应用,以及小型模型在日常应用中的潜力。专家建议,企业应将AI建设融入企业文化,以创新而非成本节约为驱动力。

字节跳动发布GAR:让AI能像人类一样精准理解图像任何区域的突破性技术

字节跳动等机构联合发布GAR技术,让AI能同时理解图像的全局和局部信息,实现对多个区域间复杂关系的准确分析。该技术通过RoI对齐特征重放方法,在保持全局视野的同时提取精确细节,在多项测试中表现出色,甚至在某些指标上超越了体积更大的模型,为AI视觉理解能力带来重要突破。

Spotify推出AI播放列表功能让用户掌控推荐算法

Spotify在新西兰测试推出AI提示播放列表功能,用户可通过文字描述需求让AI根据指令和听歌历史生成个性化播放列表。该功能允许用户设置定期刷新,相当于创建可控制算法的每周发现播放列表。这是Spotify赋予用户更多控制权努力的一部分,此前其AI DJ功能也增加了语音提示选项,反映了各平台让用户更好控制算法推荐的趋势。

Inclusion AI推出万亿参数思维模型Ring-1T:首个开源的超大规模推理引擎如何重塑AI思考边界

Inclusion AI团队推出首个开源万亿参数思维模型Ring-1T,通过IcePop、C3PO++和ASystem三项核心技术突破,解决了超大规模强化学习训练的稳定性和效率难题。该模型在AIME-2025获得93.4分,IMO-2025达到银牌水平,CodeForces获得2088分,展现出卓越的数学推理和编程能力,为AI推理能力发展树立了新的里程碑。

为AI+而生,海辰储能发布全球首款锂钠协同AIDC全时长储能解决方案

长时储能开启智慧未来:海辰储能生态日全球首发三大新品

Arm 借助融合型 AI 数据中心,重塑计算格局

奥运级别的努力:首席信息官为2026年AI颠覆做准备

Spotify推出AI播放列表功能让用户掌控推荐算法

Adobe押注生成式AI获得回报,年度营收创历史新高

OpenAI与迪士尼达成十亿美元合作协议,米老鼠和漫威角色进入Sora

甲骨文150亿美元数据中心投资导致股价下跌

Spoor鸟类监测AI软件需求飞速增长

制药行业AI数据质量危机:垃圾进垃圾出的隐患

Harness获得2.4亿美元融资,估值达55亿美元,专注自动化AI编码后的开发流程

英伟达CEO黄仁勋独家专访:万亿美元押注AI工厂将成为新时代计算机