打破存储性能瓶颈,实现AI应用的腾飞 原创

经典的“木桶理论”告诉我们,决定桶能装多少水,是由最低的那块木板来决定的。

同样目前数据在整个IT系统中的运行过程,也有一个瓶颈一直存在,就是存储介质的性能。

互联网催生了海量应用,海量应用诞生了海量的不同种类的数据。要让多元的数据发挥价值,不仅需要更强的处理器,更快的网络还有最终数据存储的读写能力。

今天算力发展喜人,多元的数据,催生着多元的算力的出现,通用算力CPU、人工智能算力GPU、TPU、NPU等处理器的蓬勃发展,X86、ARM架构等算力的架构发展。

网络技术发展喜人,移动互联、视频、直播等对于海量的数据传输需求,催生了数据中心的网络带宽100G、400G端口的发展。华为早在2018年正式发布全新400G光网络商用解决方案,支撑运营商全业务场景的400G网络快速部署。

同样存储技术在性能方面的发展并不喜人,海量的数据催生了存储技术的发展,介质上从磁盘到NAND、3D NAND的固态盘,接口从SAS、SATA、PCIE、NVME传输协议的升级。但是我们看到存储在单位容量增长的速度,远远大于单位存储传输性能的速度。数据在存储介质和外界交换的传输速度成为整个IT系统的瓶颈。

在积极突破存储瓶颈的方向上,目前提出有三种方法,一、直接采用全新的架构和技术重新定义存储技术。二、采用分布式存储,让数据分散传输来提升整个IT系统的效率。三、研发新的存储介质,包括原子存储技术和DNA存储技术。

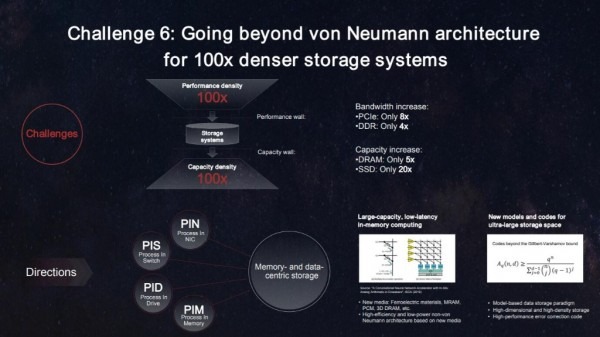

研发新的架构和技术。在不久前的2021华为全球分析师大会,华为发布了迈向智能世界2030的九大技术挑战与研究方向,其中就有针对IT架构中最后的挑战,存储性能提升给出了方向,包括构建提升存储性能百倍的新存储技术研究方向。

华为希望从突破冯诺依曼架构来提升存储能力。目前的IT架构基于冯诺依曼架构,数据在CPU、内存、存储介质之间移动,其中任何一个环境的性能差,都会对整个系统带来性能挑战。

我们看到CPU的性能一直在提升,内存的性能也在提升,网络的带宽也在提升,存储的容量也在提升,但是存储的性能却一直是瓶颈,包括当前的PCIE、NVME等存储接口的带宽速度远跟不上外部网络的性能增长。

华为的思路是要提升存储性能,需要突破冯诺依曼架构的限制,从以CPU为中心,转向以内存为中心、以数据为中心,从搬移数据转向搬移计算,打破性能墙。

还有一种方案提高数据存取的效率,当面临海量数据存取的时候,用最少的存取,实现最大的应用。这就是是分布式存储。

比如现在火热的IPFS就是一种比较火热的分布式存储系统,其核心概念是基于内容寻址、版本化、点对点的超媒体传输协议。也就是数据存取直接指向资源,并确保这些数据都是来自最近的资源。而不是先找到存放的存储介质,在调取介质里的数据。这样就大大减少了存储介质性能对于数据存取的影响。比如一个10TB的文件,可以打散分布在1000个边缘端的存储介质上。而且调用的时候,不需要下载到本地,直接调用1000个边缘端的存储性能。从而实现数据的高效利用。

第三就是新的存储介质,包括原子存储技术和DNA存储技术,如果能够真正研发出来,就能够实现存储性能的千倍以上的提升,当然目前是理论阶段,距离真正落地商业还有还长的距离。

来源:至顶网存储频道

好文章,需要你的鼓励

Aqara智能门锁U400发布:支持Apple Wallet全自动解锁

绿米推出智能门锁U400,采用超宽带技术检测携带iPhone或Apple Watch的用户实现全自动解锁。该产品支持苹果钱包添加家庭钥匙,兼容Siri语音控制。除UWB解锁外,还提供实体钥匙、指纹识别、密码等多种开锁方式。基于Thread协议需配合兼容设备使用,要求iPhone 11及以上版本或Apple Watch Series 6及以上。售价270美元,现已在美国等地上市。

剑桥大学突破性研究:如何让AI在对话中学会真正的自信判断

剑桥大学研究团队首次系统探索AI在多轮对话中的信心判断问题。研究发现当前AI系统在评估自己答案可靠性方面存在严重缺陷,容易被对话长度而非信息质量误导。团队提出P(SUFFICIENT)等新方法,但整体问题仍待解决。该研究为AI在医疗、法律等关键领域的安全应用提供重要指导,强调了开发更可信AI系统的紧迫性。

AI代码编辑器扩展推荐漏洞引发供应链安全风险

热门AI驱动的VS Code衍生工具如Cursor、Windsurf等被发现推荐Open VSX注册表中不存在的扩展程序,为恶意攻击者发布同名恶意软件包创造机会。这些IDE继承了微软扩展市场的官方推荐列表,但这些扩展在Open VSX中并不存在。攻击者可利用此漏洞上传恶意扩展,当开发者安装推荐扩展时可能导致敏感数据泄露。

威斯康星大学研究团队破解洪水监测难题:AI模型终于学会了“眼观六路“

威斯康星大学研究团队开发出Prithvi-CAFE洪水监测系统,通过"双视觉协作"机制解决了AI地理基础模型在洪水识别上的局限性。该系统巧妙融合全局理解和局部细节能力,在国际标准数据集上创造最佳成绩,参数效率提升93%,为全球洪水预警和防灾减灾提供了更准确可靠的技术方案。

AI代码编辑器扩展推荐漏洞引发供应链安全风险

身份暗物质威胁企业网络安全的新挑战

Ambiq推出首款能耗优化NPU芯片组,为电池设备带来先进AI能力

英伟达推出AI推理上下文NVMe SSD存储解决方案

Infinidat最新升级让勒索软件攻击者胆寒

Lightricks-2 AI视频模型实现设备端运行突破

微软收购Osmos数据平台,强化Fabric智能数据工程能力

微软Excel股票历史功能新年故障,用户纷纷寻找替代方案

Infinidat最新升级让勒索软件攻击者不寒而栗

Commonwealth Fusion Systems完成首个反应堆磁体安装并与英伟达达成合作

宏碁游戏产品线扩展平价硝基系列,推出全新显示面板

DayOne数据中心获得20亿美元C轮融资,推进全球建设计划