快讯:华为正研究容量和性能提升100倍的新型存储 原创

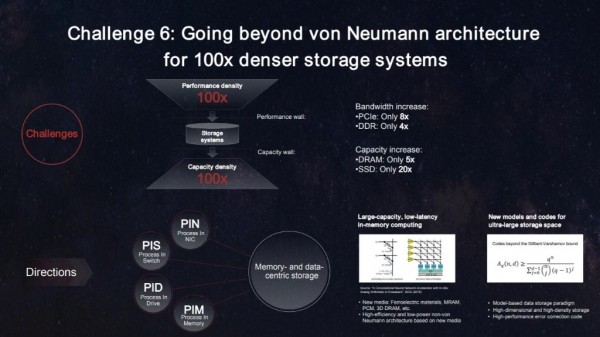

面对目前存储与计算之间的性能瓶颈和存储容量瓶颈,在2021华为全球分析师大会,华为发布了迈向智能世界2030的九大技术挑战与研究方向 ,其中包括突破冯诺依曼限制,构建百倍密度增长的新型存储的技术挑战和研究方向。

存储面临两大问题是存得下、用得好

第一,要存得下。单位空间和能耗下的存储密度要提升100倍,而当前介质技术受限工艺、功耗限制,无法支撑。未来存储系统要突破新型大容量低时延内存技术,突破DNA存储、高维新型光存储等超大容量介质技术,突破超大存储空间模型和编码技术,打破容量墙。

第二,要用得好。未来存储系统的数据访问带宽将从TB级到PB级、访问时延将从ms级降到us级,性能密度须百倍提升。冯诺依曼架构下,数据要在CPU、内存、介质之间移动,而当前PCIE、DDR带宽速度远跟不上外部网络的性能增长。未来存储系统要突破冯诺依曼架构的限制,从以CPU为中心,转向以内存为中心、以数据为中心,从搬移数据转向搬移计算,打破性能墙。

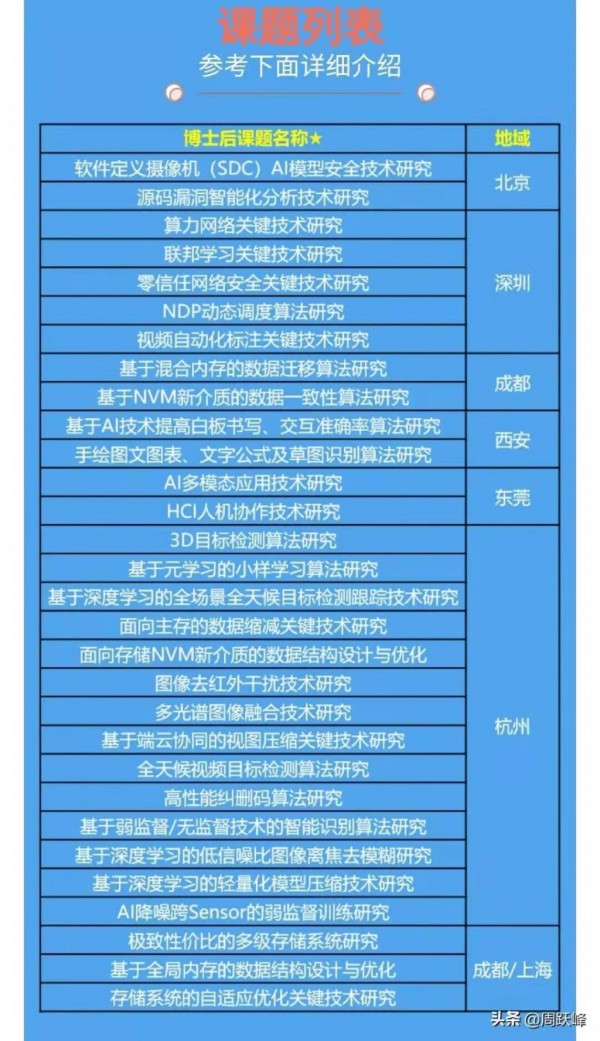

而这些工作正在有序进行,其中2021年,华为在存储研究领域已经开展博士后研究课题。

华为副总裁、数据存储与机器视觉产品线总裁周跃峰在个人今日头条号上已经开展了【2021年华为数据存储与机器视觉博士后研究课题】

数据被誉为智能世界的“新石油”,是未来数字世界的基础生产资料。华为数据存储与机器视觉产品线在全球拥有12大研发中心,4000+研发工程师,技术领域涉及介质存储、分布式存储、SSD存储、计算机视觉、图形图像处理、AI、软件根技术及ID&UX等核心技术领域。“

周跃峰 表示 ” ”围绕数据作战,数据智能感知(机器视觉、智能协作、融合视频)、数据存储(海量存储、分布式存储)及数据智能管理,围绕数据全生命周期,让数据的每比特成本最优、每比特价值最大,构建最强数据基础设施,释放数据价值,点亮数字文明。“

来源:至顶网存储频道

好文章,需要你的鼓励

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

很多人担心被AI取代,陷入无意义感。按照杨元庆的思路,其实无论是模型的打造者,还是模型的使用者,都不该把AI放在人的对立面。

MIT递归语言模型:突破AI上下文限制的新方法

MIT研究团队提出递归语言模型(RLM),通过将长文本存储在外部编程环境中,让AI能够编写代码来探索和分解文本,并递归调用自身处理子任务。该方法成功处理了比传统模型大两个数量级的文本长度,在多项长文本任务上显著优于现有方法,同时保持了相当的成本效率,为AI处理超长文本提供了全新解决方案。

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

谷歌宣布对Gmail进行重大升级,全面集成Gemini AI功能,将其转变为"个人主动式收件箱助手"。新功能包括AI收件箱视图,可按优先级自动分组邮件;"帮我快速了解"功能提供邮件活动摘要;扩展"帮我写邮件"工具至所有用户;支持复杂问题查询如"我的航班何时降落"。部分功能免费提供,高级功能需付费订阅。谷歌强调用户数据安全,邮件内容不会用于训练公共AI模型。

华为研究团队突破代码修复瓶颈,8B模型击败32B巨型对手!

华为研究团队推出SWE-Lego框架,通过混合数据集、改进监督学习和测试时扩展三大创新,让8B参数AI模型在代码自动修复任务上击败32B对手。该系统在SWE-bench Verified测试中达到42.2%成功率,加上扩展技术后提升至49.6%,证明了精巧方法设计胜过简单规模扩展的技术理念。

联想集团混合式AI实践获权威肯定,CES期间获评“全球科技引领企业”

CES上杨元庆首谈AGI,碾压人类的叙事不会让AI更聪明

CES 2026 | 重大更新:NVIDIA DGX Spark开启“云边端”模式

Gmail新增Gemini驱动AI功能,智能优先级和摘要来袭

研究发现商业AI模型可完整还原《哈利·波特》原著内容

Razer在2026年CES展会推出全息AI伴侣项目

CES 2026:英伟达新架构亮相,AMD发布新芯片,Razer推出AI奇异产品

通过舞蹈认识LimX Dynamics的人形机器人Oli

谷歌为Gmail搜索引入AI概览功能并推出实验性AI智能收件箱

DuRoBo Krono:搭载AI助手的智能手机尺寸电子阅读器

OpenAI推出ChatGPT Health医疗问答功能

Anthropic寻求3500亿美元估值融资100亿美元