IBM推出Hyperstore:将NVMe-oF引入Storage Scale以加快远程数据访问

IBM正在为Storage Scale规划“Hyperstore”升级方案,希望借助NVMe over Fabrics加快远程驱动器上的数据获取速度。

Storage Scale是IBM旗下备受推崇的GPFS(通用并行文件系统)的最新版本,其通过各文件系统节点(即服务器)的并行运行以加快文件读写速度。NVMe over Fabrics(简称NVMe-OF)是一种协议,可有效扩展PCIe总线并跨TCP/IP、光纤通道、iSCSI和以太网网络链路运行,为目标服务器提供直接的块级存储驱动器访问。

IBM公司IT架构师Frank Kraemer认为,Tom Lyon在《NFS必须消亡(NFS must die)》一文中表达的观点“非常酷”,并表示“我们打算使用NVMe-oF来提高速度,但仍将保留文件系统接口及Erasure Coding(GPFS Native Raid,简称GNR)的传统方式以实现易用性与安全操作。”

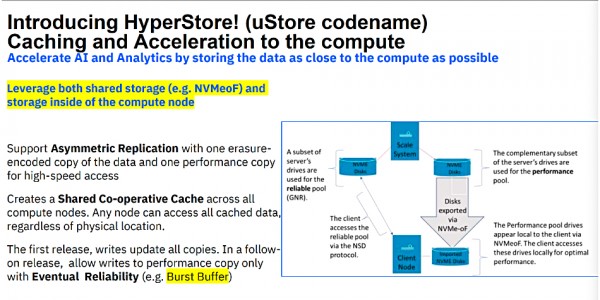

这些计划均以Storage Scale上的Hyperstore功能为中心,由其负责提供NVMe-oF性能池。

在高性能计算(HPC)用户论坛上,IBM发布的演示文稿《IBM供应商更新——存储篇》也提到了这一概念。IBM数据与AI存储解决方案部门存储文件与对象系统首席架构师Chris Maestas表示,在混合和多云世界中数据可谓无处不在,而基于CPU和GPU的算力都希望能像访问本地数据那样访问远程数据。

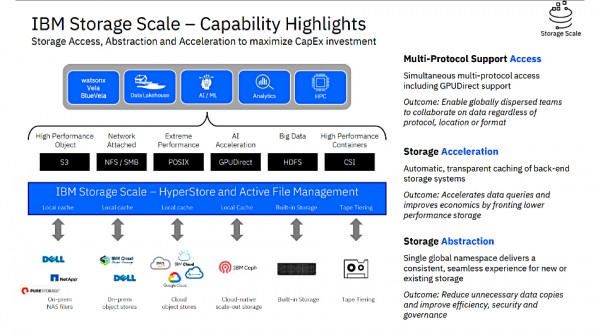

Storage Scale主要通过提供存储访问、使用单一全局命名空间抽象以及加速等方式达成这一目标,具体如以下页面所示:

在谈到AI工作负载与GPU时,他表示管理员可以拉近远程数据与计算资源之间的距离,使用NVMe-oF模拟GPU计算节点上的本地存储。这一设计原则在SC22大会上也得到了展示,IBM打造的配备SSD的ESS 3500能够为计算客户端提供超过1000万IOPS的吞吐量及数百GBps的传输带宽。为此,该系统还集成有IOPS极高的存储池。

这也正是Hyperstore的起点:

Hyperstore上周于伦敦面向Spectrum Scale User Group首次亮相。这是一套分层系统,Storage Scale使用GNR(native declustered RAID)、性能池与客户端计算节点上的本地驱动器,共同提供可靠的中间存储池。

其使用网络共享磁盘(NSD)访问这套可靠存储池,NSD是文件存储系统网络上存储磁盘的逻辑分组。Storage Scale会对各NSD服务器上的文件进行切片,再将各切片存储为数据块。访问客户端则对各NSD服务器执行实时并行IO。

性能池驱动器属于可靠池驱动器中的子集,使用速度更快的NVMe-oF进行访问,且全部计算节点共享统一的缓存。

关于Hyperstore的更多细节将在未来几个月内公布。

来源:至顶网存储频道

好文章,需要你的鼓励

据说算力高达1000 TOPS,华硕Ascent GX10深度评测——开箱

当超级计算机被压缩进一个比书本还小的盒子里,这画面有多炸裂?想象一下,你桌面上摆着的不是什么花瓶摆件,而是一台能跑200B参数AI推理的"超算怪兽"——这就是我们今天要聊的主角:华硕Ascent GX10。

Adobe与UCLA联手突破AI模型速度瓶颈:让图像生成快一倍的“稀疏化魔法“

Adobe研究院与UCLA合作开发的Sparse-LaViDa技术通过创新的"稀疏表示"方法,成功将AI图像生成速度提升一倍。该技术巧妙地让AI只处理必要的图像区域,使用特殊"寄存器令牌"管理其余部分,在文本到图像生成、图像编辑和数学推理等任务中实现显著加速,同时完全保持了输出质量。

不用再训练AI模型,香港科技大学团队发明“智能管家“,让AI一眼就知道该抓哪里用哪里

香港科技大学团队开发出A4-Agent智能系统,无需训练即可让AI理解物品的可操作性。该系统通过"想象-思考-定位"三步法模仿人类认知过程,在多个测试中超越了需要专门训练的传统方法。这项技术为智能机器人发展提供了新思路,使其能够像人类一样举一反三地处理未见过的新物品和任务。

据说算力高达1000 TOPS,华硕Ascent GX10深度评测——开箱

苹果发现:只需一个注意力层,就能让AI图像生成既快又好

YouTube推出基于Gemini 3的创作者游戏制作工具

英伟达是唯一能负担免费提供AI模型的厂商

OpenAI发布新旗舰图像生成AI模型GPT Image 1.5

脑启发算法可大幅降低AI能耗

Mac办公桌升级必备配件指南:提升工作效率的最佳选择

PTC Windchill+ 助力 HOLON研发全球首批符合汽车行业标准的 L4 级电动汽车

航旅行业的AI“乘法效应”:迈向指数级进化

OpenAI推出GPT Image 1.5模型加速图像生成竞争

Zoom推出AI Companion 3.0智能体工作流程

ChatGPT成为互联网最受阻止的爬虫机器人