索尼&Infortrend渠道大会即将启程!

历时1个多月,覆盖5个城市的SONY全国渠道大会将于10月金秋正式启程,Infortrend作为战略合作伙伴将全程一起参与,将先后赴乌鲁木齐、重庆、青岛、长沙、贵阳5座城市进行渠道活动。Infortrend将为您展示"媒资管理+存储+AI智能"的合作方案,为用户提供强劲的媒资管理工具及安全高效的存储解决方案。

方案一

媒资管理存储一体机 - EonStor GSe Pro

在轻量化的系统中配有Docker设计,嵌入索尼NavigatorX媒资管理软件,组成媒资存储管理一体机,提供高安全、高性能、高稳定性、高性价比的企业级NAS存储,卓越的扩展能力可满足存储空间长期增长需求。实现媒资收集,保存,查找,编辑,发布等需求。适用于中、小企业公办文件共享、资料备份(云端备份)、媒体资源管理、数字化图书馆等应用场景。

方案二

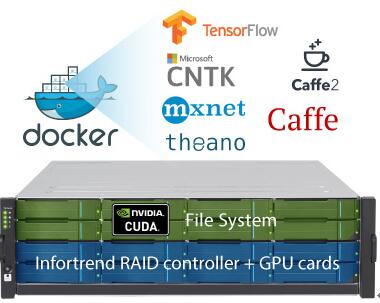

高度集成计算与存储于一体的深度学习平台 - EonStor GSi

Infortrend GSi集SAN、NAS、云端、深度学习平台于一身,产品采用NVDIA GPU卡,支持CUDA加速。内嵌Docker平台,搭建TensorFlow, Caffe, Caffe2, Theano 架构。实现快速部署,操作简易,为AI智能应用提供强大的浮点运算能力,是智慧城市、智慧校园、医疗影像智能分析、智能配色、股票走势、自动驾驶、3D建模等应用完美的解决方案。

方案三

高性价比媒资数据存储解决方案

大数据时代下面对数据量快速增长,对存储的需求成几何式增长,后期对海量数据的智能存储和快速查询提出严格诉求。Infortrend与索尼合作共同推多种高性价比、性能稳定的存储解决方案,应对媒资客户对存储的需求。

Infortrend存储产品能够提供高效的性能、安全可靠的数据服务、灵活的易用性,有效保证用户数据的安全性及业务持续性。广泛应用于政府、企业、广电、教育、医疗、金融、制造等行业。

来源:业界供稿

好文章,需要你的鼓励

亚马逊推出Alexa网页版:生成式AI助手的新选择

亚马逊在CES期间宣布推出Alexa.com网站,用户可像使用其他AI聊天机器人一样与Alexa交互。经过数月早期体验,Alexa+已获得数千万用户。新网站支持语音和文本交互,需登录使用以确保跨设备功能连续性。76%的Alexa+交互为独特任务,包括智能家居控制和第三方集成。Alexa+兼容七年来的设备,正式版将收费每月20美元或包含在Prime会员中。

UCSD团队打造终极仿真世界:让AI智能体在虚拟城市中自立更生的惊人实验

SimWorld是由UCSD等多所顶尖院校联合开发的革命性AI仿真平台,基于虚幻引擎5构建了具备真实物理规律的虚拟城市环境。该平台支持无限扩展的程序化世界生成和自然语言交互,让AI智能体能够在复杂环境中学会生存、合作和竞争,为通用人工智能的发展提供了前所未有的训练平台。

Plaud推出可穿戴AI记录设备NotePin S,CES 2026记者新利器

AI笔记公司Plaud在CES 2026推出新款可穿戴设备NotePin S,可夹在衣领、戴在手腕或挂在脖子上记录对话。该设备通过蓝牙连接手机,配备双麦克风,录制范围约3米,支持一键高亮标记重要时刻。同时发布的还有Plaud Desktop桌面AI记录工具,可原生捕获线上会议内容,无需机器人加入通话。两款产品将所有笔记、会议和对话整合到统一平台管理。

浙江大学团队提出C2DLM:让AI推理更像人类思维的全新语言模型

浙江大学联合华为提出C2DLM,这是一种因果概念引导的扩散语言模型,通过自动提取因果关系并融入注意力机制来增强AI推理能力。相比传统方法,C2DLM在推理任务上平均提升1.31%-12%,训练效率提高3.2倍,为解决语言模型推理能力不足开辟了新路径。

亚马逊推出Alexa网页版:生成式AI助手的新选择

Plaud推出可穿戴AI记录设备NotePin S,CES 2026记者新利器

机器人初创公司推出现实版瓦力机器人及其他伴侣产品

VisIC宣布完成2,600万美元B轮融资

CES 2026 | AMD扩张“边缘统治力” “芯片级异构”塑造汽车、工业边缘应用“新法则”

CES 2026 | NVIDIA新风向: Rubin平台面市 ,系统级“AI工厂”成型,物理AI加速落地

英伟达Vera-Rubin平台推出前六月已淘汰现有AI硬件

英特尔推出首批18A工艺制程的Core Ultra处理器

Rokid在CES 2026推出无屏AI智能眼镜

英伟达物理AI模型为新一代机器人铺路

微软发布 GitHub Copilot 的 C++ 代码编辑工具

至顶AI实验室硬核评测:戴尔Precision 5690移动工作站,部署DeepSeek+LobeChat打造个人超级智能体

索尼与本田联手打造Afeela电动车,起售价8.99万美元

开启体育数字化新纪元,索尼成为 “2024上海明日之星篮球争冠赛”官方赞助商

激发下一代的科学梦想与热情 “索尼探梦科普万里行”2024年首站登陆羊城

CES 2024 | 索尼发布XR一体机,搭载骁龙XR2+ Gen 2

索尼于进博会首发新型环境技术“协生农法”智能协生APP

索尼在进博会宣布将YURU MUSIC(悠如音乐)项目引进中国

早期机器狗步入“老年”,索尼为此推出“寄养”计划

索尼推出“出发!探索编程世界(TM)教育版”及toio 教育教学解决方案

索尼的智能手机动作追踪系统将于本月在美国上市 售价:449美元

索尼Mocopi运动跟踪器:一款VR版的AirTag