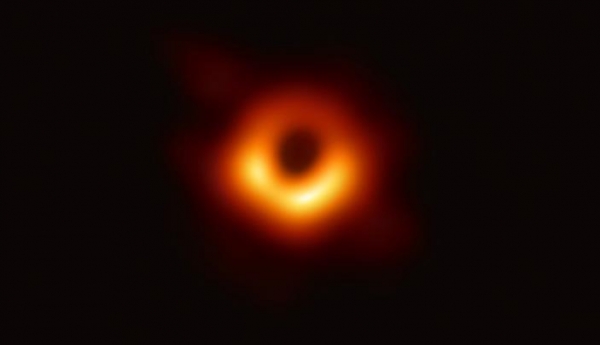

全球首张黑洞照片火了,其背后的超算中心能做的事情还有很多! 原创

4月11日,全球首张黑洞照片发布。看过相关报道的都知道,这张照片的出炉很不容易。首先是,通过全球8台亚毫米射电望远镜构建成口径13000公里的超级“虚拟”望远镜——视界面望远镜(EHT)进行“拍照”,拍照之后的是“洗”照片。而洗照片需要处理百万G数据。这背后是超算中心在支撑。

大家是不是好奇,超算中心是如何运算处理这些数据来“洗”照片的。上海超算中心副主任李根国表示黑洞照片形成主要有两部分数据,第一是观察获得的数据,第二是演化模拟的数据。

一个方面是基于观测的数据,通过望远镜基于观测或者卫星采集数据,这些数据是一个天文数字,比如此次黑洞照片每台望远镜都记录了大约1 PB(100万GB)的总数据。

第二个方面是基于计算机的演化模拟,整个宇宙符合一定的运动规律,比如地球围绕太阳旋转,整个太阳系如何在银河系运转。通过宇宙的运动规律,再加上观测数据,就要有大量的CPU和超级计算机来计算出结果。

上海超算中心作为一个公共的服务平台,面向全社会服务的资源。虽然因为黑洞照片火了一把,但是普通民众对于超算中心的概念还是比较模糊。李根国形象的把超算中心比喻为发电厂,超算中心提供的是计算力,电厂提供的是电力,普通民众看到的电力资源是通过电网来获取的,现在的计算力也是通过互联网提供给广大用户。

上海超算中心副主任李根国

今天超算中心的作用逐步从科学走向企业。基于社会各界对于计算能力的需求增加,上海超算中心也不断在提升自己的计算能力,为全社会提供计算服务。同时上海超算中心与英特尔成立了联合实验室,这个联合实验室来测试英特尔最新款的CPU的性能和应用,包括对近期发布的基于第二代英特尔至强可扩展处理器的曙光先进计算服务器系列产品。

李根国透露目前上海超算中心正在部署新的第6台超级计算机,这台超级计算机是由中科曙光制造的,内部搭载了第二代英特尔至强可扩展处理器,计算能力为3.3PF。相对于目前上海超算中心的魔方2超级计算机,算力提升了10倍。这样就能继续满足不同类型的特别是工业和科学计算的需求。

第二代英特尔至强可扩展处理器,除了满足计算处理,同时集成加速面向大数据和人工智能深度学习推理的加速技术。新的处理器兼顾了计算的同时也兼顾了新的需求,特别是大数据和人工智能的需求,这在超算里面也有新的方向,因此在超算领域一个方面在为传统的科学家提供资源,同时因为政府的公共服务平台,也会面向新的应用方向就是人工智能,特别是制造业,制造业里面类似于有一些厂商做自动驾驶的,这些工作也是需要超级算力作为支撑。

展望超算,未来大有可为

在物理、化学领域里,目前的高性能计算应用大部分采用分子动力学、量子力学等方法,通过计算模拟来研究微观系统的行为。这类研究一般都需要进行较大并行度规模计算。研究体系的规模越大、越复杂、越精选,需要的计算资源也越多,计算的并行度也越大。

在生物、医药领域里,高性能计算应用主要涉及到蛋白质研究、基因比对、药物筛选、器官模拟等。在这些领域的计算模拟中,除了采用物理、化学研究中的计算方法外,还会涉及很多数据处理类型的计算,这类计算的特点是任务量特别大,但对计算的并行度要求不高。

在天文学和天体物理的研究中,高性能计算主要通过采用牛顿力学的方法研究星系演变、星体力场等宏观天体的行为。这类计算往往需要较多的计算资源,进行较大并行规模的计算。

在航空航天领域中,数值计算被大量地用于飞行器设计、飞行过程模拟等。例如,在飞机设计过程中,数值计算是方案设计总体和气动设计的最为重要手段之一。人们可以通过计算空气动力学,观察计算模拟的流动现象,分析计算结果,验证设计思想和方法,优化设计方向,为设计工作的推进提供有力的数据支持。此外,人们还可以通过计算模拟,对航天器材的结构设计、材料特性等进行优化和改进等。

在采访过程中,李根国多次表示,对于超级计算的应用,其实最重要的是软件,目前绝大多数的工业仿真软件、科学计算的软件,都是基于国外开源的软件在做。未来希望有越来越多的国产软件可以应用在超级计算机上。

来源:至顶网存储频道

好文章,需要你的鼓励

裕同科技墨西哥瓜达拉哈拉设厂:精品纸包装龙头追着AI硬件去北美

今天讲的出海案例是深圳的精品纸包装龙头裕同科技,把工厂开到墨西哥瓜达拉哈拉,紧贴着北美的服务器与AI硬件客户做本地化交付。

英伟达造了个“驾驶梦境生成器“,让自动驾驶汽车在虚拟世界里先把事故撞个够

英伟达推出OmniDreams,一个基于Cosmos扩散模型微调的自动驾驶生成式世界模型,可实时生成逼真驾驶视频,支持极端天气等长尾场景的闭环仿真测试。

在 Mac 上使用 Gemini 的更好方式

Google于今年4月推出了Gemini Mac专属应用,但两个月后来看,该应用存在明显不足。作者更倾向于使用Safari的"添加到Dock"功能来运行Gemini网页版,原因包括:支持Command+N快速开启多个聊天窗口、部分对话线程在Mac应用中无法正常使用,以及Mac应用存在图标显示问题。更严重的是,Gemini Mac应用会在用户不知情的情况下安装后台程序,且被删除后还会自动恢复,引发用户强烈不满。

谷歌与康奈尔大学联手:给AI大模型设计“睡眠机制“,让它学会像人脑一样巩固记忆

谷歌研究院与康奈尔大学联合提出"Sleep"框架,受人类睡眠启发,通过记忆巩固与做梦两阶段让AI大模型持续学习、抵抗遗忘并自我提升。

尼得科研发300kW机柜内CDU原型机,力争2027年第一季度启动量产

裕同科技墨西哥瓜达拉哈拉设厂:精品纸包装龙头追着AI硬件去北美

在 Mac 上使用 Gemini 的更好方式

Steam主机夏季发布日期确认,但售价仍未公布

T1 Energy收购KORE Power,布局AI数据中心储能市场

Wallbox在西班牙完成首批Supernova PowerRing直流快充桩部署

比亚迪旗下腾势Z9 GT:续航超1000公里,开局火爆

iPhone Ultra将搭载Touch ID而非Face ID,原因在这里

Microsoft Edge密码管理器将强制使用Windows Hello进行身份验证

丰田电动SUV热销,为何此时却放缓电动化步伐?

智能家居新篇章:从零开始打造全新智能生活

我让ChatGPT为我免费构建了一个PDF编辑器,因为我不信任它直接修改文件——结果它成功了!